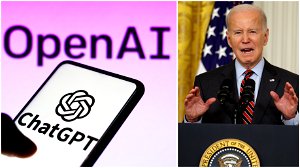

Depuis que ChatGPT a été rendu public, une révolution s’est mise en marche. Et si la multiplication des IA génératives a eu du bon à de nombreux niveaux, elle a aussi des côtés sombres et c’est justement ce qui inquiète les États-Unis.

L’actualité : le département du Commerce américain demande l’avis du public sur de potentielles mesures de responsabilités pour les IA génératives telles que ChatGPT.

- Les autorités politiques américaines s’inquiètent de l’impact qu’elles pourraient avoir sur la sécurité nationale et l’éducation.

- Elles cherchent à savoir si des mesures permettraient de garantir « que les systèmes d’IA sont légaux, efficaces, éthiques, sûrs et dignes de confiance ».

- On sait depuis longtemps maintenant que les IA peuvent présenter des biais en raison des bases de données sur lesquelles elles sont formées.

- « Des systèmes d’IA responsables pourraient apporter d’énormes avantages, mais seulement si nous nous attaquons à leurs conséquences et préjudices potentiels. Pour que ces systèmes atteignent leur plein potentiel, les entreprises et les consommateurs doivent pouvoir leur faire confiance », a déclaré Alan Davidson, administrateur de la National Telecommunications and Information Administration (NTIA).

Un rapport non contraignant

À terme : les commentaires sont ouverts durant 60 jours. Au terme, la NTIA rédigera un rapport sur base des avis reçus afin d’aider les décideurs politiques américains à aborder la question des IA génératives.

- À l’administration Biden ensuite de prendre en compte ou non ces conseils pour « assurer une approche cohérente et complète du gouvernement fédéral à l’égard des risques et des opportunités liés à l’IA ».

Contexte : le fait que ChatGPT ait atteint 100 millions d’utilisateurs le plus rapidement que n’importe quelle autre application grand public de l’histoire est ce qui inquiète le plus les politiques.

- Des représentants de l’industrie technologie, dont Elon Musk et Steve Wozniak (co-fondateur d’Apple), et du gouvernement, ont exprimé leur inquiétude quant aux dommages potentiels que peut avoir l’IA.

- Les chatbots tels que ChatGPT peuvent en effet être utilisés pour commettre des crimes – création de campagnes de phishing ou de virus –, et diffuser de fausses informations.

- Les IA génératives peuvent présenter des erreurs dans leurs réponses, sans que cela soit dû à une utilisation malveillante, comme ce fut le cas avec Bard de Google, mais aussi Bing IA de Microsoft. Mais ChatGPT a également ses défauts.

Une demande croissante de réglementation

À noter : les États-Unis ne sont pas les seuls à se demander s’il faut encadrer ou non les intelligences artificielles.

- Plusieurs pays s’inquiètent en effet de cette technologie en plein boom. Outre les utilisations criminelles possibles, ils s’interrogent sur le respect de la vie privée de leurs utilisateurs.

- La Chine a annoncé la mise en place prochaine de règles visant à encadrer les chatbots dans le pays.